-

- 我的供應(yīng)

- 發(fā)布供應(yīng)產(chǎn)品

- 管理供應(yīng)產(chǎn)品

- 我的資訊

- 發(fā)布新聞資訊

- 管理新聞資訊

- 我的采購

- 發(fā)布采購信息

- 管理采購信息

- 我的收藏

- 我收藏的店鋪

- 我收藏的產(chǎn)品

繼Windows Copilot發(fā)布后,微軟Build大會(huì)熱度又被一場演講引爆。

前特斯拉AI總監(jiān)Andrej Karpathy在演講中認(rèn)為思維樹(tree of thoughts)與AlphaGo的蒙特卡洛樹搜索(MCTS)有異曲同工之妙!

網(wǎng)友高呼:這是關(guān)于如何使用大語言模型和GPT-4模型的最詳盡有趣的指南!

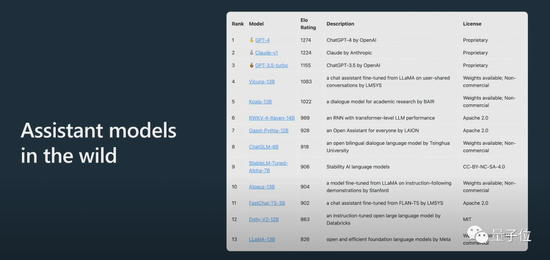

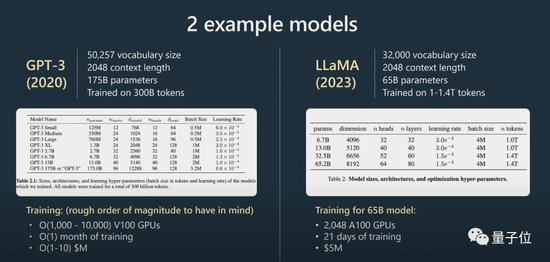

此外Karpathy透露,由于訓(xùn)練和數(shù)據(jù)的擴(kuò)展,LLAMA 65B“明顯比GPT-3 175B更強(qiáng)大”,并介紹了大模型匿名競技場ChatBot Arena:

Claude得分介于ChatGPT 3.5和ChatGPT 4之間。

網(wǎng)友表示,Karpathy的演講一向很棒,而這次的內(nèi)容也一如既往沒有令大家失望。

隨著演講而爆火的,還有推特網(wǎng)友根據(jù)演講整理的一份筆記,足足有31條,目前轉(zhuǎn)贊量已超過3000+:

所以,這段備受關(guān)注的演講,具體提到了哪些內(nèi)容呢?

如何訓(xùn)練GPT助手?

Karpathy這次的演講主要分為兩個(gè)部分。

第一部分,他講了如何訓(xùn)練一個(gè)“GPT助手”。

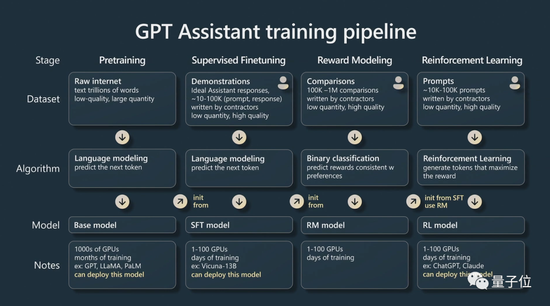

Karpathy主要講述了AI助手的四個(gè)訓(xùn)練階段:

預(yù)訓(xùn)練(pre-training)、監(jiān)督微調(diào)(supervised fine tuning)、獎(jiǎng)勵(lì)建模(reward modeling)和強(qiáng)化學(xué)習(xí)(reinforcement learning)。

每一個(gè)階段都需要一個(gè)數(shù)據(jù)集。

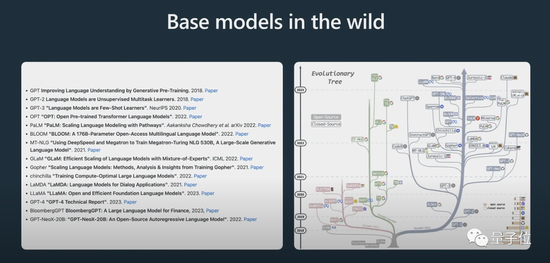

在預(yù)訓(xùn)練階段,需要?jiǎng)佑么罅康挠?jì)算資源,收集大量的數(shù)據(jù)集。在大量無監(jiān)督的數(shù)據(jù)集上訓(xùn)練出一個(gè)基礎(chǔ)模型。

Karpathy用了更多例子作補(bǔ)充:

接下來進(jìn)入微調(diào)階段。

使用較小的有監(jiān)督數(shù)據(jù)集,通過監(jiān)督學(xué)習(xí)對(duì)這個(gè)基礎(chǔ)模型進(jìn)行微調(diào),就能創(chuàng)建一個(gè)能夠回答問題的助手模型。

他還展示了一些模型的進(jìn)化過程,相信很多人之前已經(jīng)看過上面這張“進(jìn)化樹”的圖了。

Karpathy認(rèn)為目前最好的開源模型是Meta的LLaMA系列(因?yàn)镺penAI沒有開源任何關(guān)于GPT-4的內(nèi)容)。

在這里需要明確指出的是,基礎(chǔ)模型不是助手模型。

雖然基礎(chǔ)模型可以回答問題,但它所給出的回答并不可靠,可用于回答問題的是助手模型。在基礎(chǔ)模型上進(jìn)行訓(xùn)練的助手模型,通過監(jiān)督微調(diào),在生成回復(fù)和理解文本結(jié)構(gòu)方面的表現(xiàn)將優(yōu)于基礎(chǔ)模型。

在訓(xùn)練語言模型時(shí),強(qiáng)化學(xué)習(xí)是另一個(gè)關(guān)鍵的過程。

通過用人工標(biāo)記的高質(zhì)量的數(shù)據(jù)進(jìn)行訓(xùn)練,可以使用獎(jiǎng)勵(lì)建模來創(chuàng)建一個(gè)損失函數(shù),以改善其性能。然后,通過增加正向的標(biāo)記,并降低負(fù)面標(biāo)記的概率,來進(jìn)行強(qiáng)化訓(xùn)練。

而在具有創(chuàng)造性的任務(wù)中,利用人類的判斷力對(duì)于改進(jìn)AI模型至關(guān)重要,加入人類的反饋可以更有效地訓(xùn)練模型。

經(jīng)過人類反饋的強(qiáng)化學(xué)習(xí)后,就可以得到一個(gè)RLHF模型了。

模型訓(xùn)練好了,接下來就是如何有效利用這些模型解決問題了。

如何更好地使用模型?

在第二部分,Karpathy主要討論了提示策略、微調(diào)、快速發(fā)展的工具生態(tài)系統(tǒng)以及未來的擴(kuò)展等問題。

Karpathy又給出了具體示例來說明:

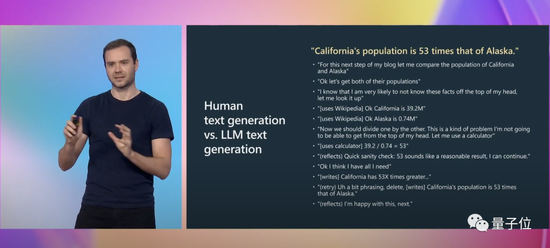

當(dāng)我們?cè)趯懳恼聲r(shí)候,我們會(huì)進(jìn)行很多的心理活動(dòng),需要考慮自己的表述是否正確。而對(duì)于GPT來說,這只是一個(gè)序列標(biāo)記(a sequence of tokens)。

而提示(prompt)可以彌補(bǔ)這種認(rèn)知差異。

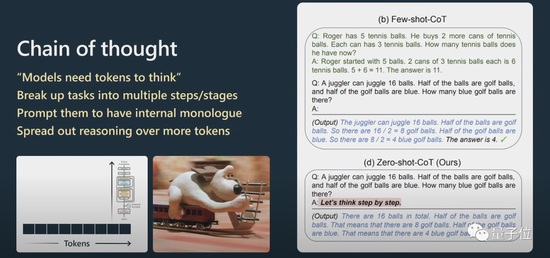

Karpathy進(jìn)一步解釋了思維鏈提示的工作方式。

對(duì)于推理問題,要想讓自然語言處理中Transformer的表現(xiàn)更好,需要讓它一步一步地處理信息,而不能直接拋給它一個(gè)非常復(fù)雜的問題。

如果你給它幾個(gè)例子,它會(huì)模仿這個(gè)例子的模版,最終生成的結(jié)果會(huì)更好。

模型只能按照它的序列來回答問題,如果它生成的內(nèi)容是錯(cuò)誤的,你可以進(jìn)行提示,讓它重新生成。

如果你不要求它檢查,它自己是不會(huì)檢查的。

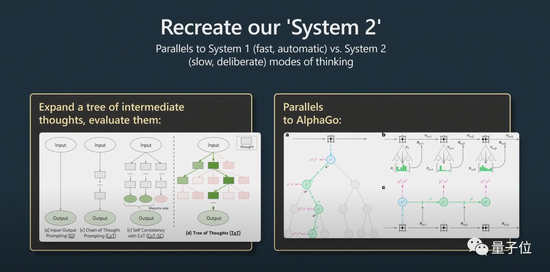

這就涉及到了System1和System2的問題。

諾貝爾經(jīng)濟(jì)學(xué)獎(jiǎng)得主丹尼爾卡尼曼在《思考快與慢》中提出,人的認(rèn)知系統(tǒng)包含System1和System2兩個(gè)子系統(tǒng)。System1主要靠直覺,而System2是邏輯分析系統(tǒng)。

通俗來說,System1是一個(gè)快速自動(dòng)生成的過程,而System2是經(jīng)過深思熟慮的部分。

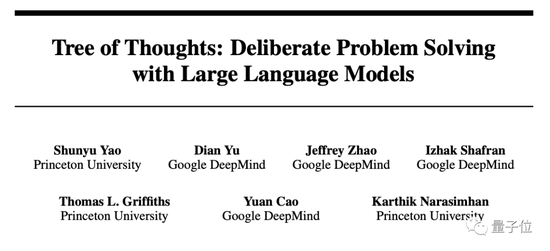

這在最近一篇挺火的論文“Tree of thought”(思維樹)中也有被提及。

深思熟慮指的是,不是簡單的給出問題的答案,而更像是與Python膠水代碼一起使用的prompt,將許多prompt串聯(lián)在一起。模型必須要維護(hù)多個(gè)提示,還必須要執(zhí)行一些樹搜索算法,來找出要擴(kuò)展的提示。

Karpathy認(rèn)為這種思路與AlphaGo非常相似:

AlphaGo在下圍棋時(shí),需要考慮下一枚棋子下在哪里。最初它是靠模仿人類來學(xué)習(xí)的。

但除此之外,它還進(jìn)行了蒙特卡洛樹搜索,可以得到具有多種可能性的策略。它可以對(duì)多種可能的下法進(jìn)行評(píng)估,僅保留那些較好的策略。我認(rèn)為這在某種程度上相當(dāng)于AlphaGo。

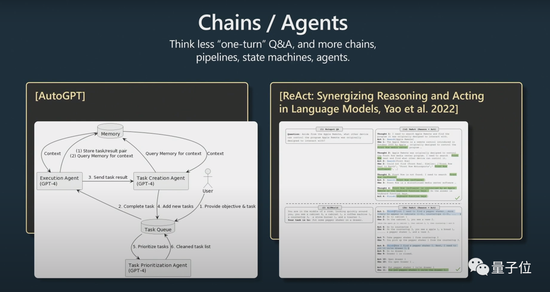

對(duì)此,Karpathy還提到了AutoGPT:

我認(rèn)為目前它的效果還不是很好,我不建議大家進(jìn)行實(shí)際應(yīng)用。我只是認(rèn)為,隨著時(shí)間的推移,我們或許可以從它的發(fā)展思路中汲取靈感。

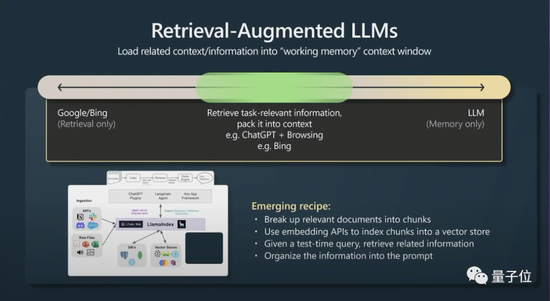

其次,還有一個(gè)小妙招是檢索增強(qiáng)生成(retrieval agumented generation)和有效提示。

窗口上下文的內(nèi)容就是transformers在運(yùn)行時(shí)的記憶(working memory),如果你可以將與任務(wù)相關(guān)的信息加入到上下文中,那么它的表現(xiàn)就會(huì)非常好,因?yàn)樗梢粤⒓丛L問這些信息。

簡而言之,就是可以為相關(guān)數(shù)據(jù)建立索引讓模型可以高效訪問。

如果Transformers也有可參考的主要文件,它的表現(xiàn)會(huì)更好。

最后,Karpathy簡單講了一下在大語言模型中的約束提示(Constraint prompting)和微調(diào)。

可以通過約束提示和微調(diào)來改進(jìn)大語言模型。約束提示在大語言模型的輸出中強(qiáng)制執(zhí)行模板,而微調(diào)則調(diào)整模型的權(quán)重以提高性能。

我建議在低風(fēng)險(xiǎn)的應(yīng)用中使用大語言模型,始終將它們與人工監(jiān)督相結(jié)合,將它們看作是靈感和建議的來源,考慮copilots而不是讓它們完全自主代理。

關(guān)于Andrej Karpathy

Andrej Karpathy博士畢業(yè)后的第一份工作,是在OpenAI研究計(jì)算機(jī)視覺。

后來OpenAI聯(lián)合創(chuàng)始人之一的馬斯克看上了Karpathy,把人挖到了特斯拉。但也因?yàn)檫@件事,馬斯克和OpenAI徹底鬧翻,最后還被踢出局。在特斯拉,Karpathy是Autopilot、FSD等項(xiàng)目的負(fù)責(zé)人。

今年二月份,在離開特斯拉7個(gè)月后,Karpathy再次加入了OpenAI。

最近他發(fā)推特表示,目前對(duì)開源大語言模型生態(tài)系統(tǒng)的發(fā)展饒有興趣,有點(diǎn)像早期寒武紀(jì)爆發(fā)的跡象。

責(zé)任編輯 :

[聲明]本網(wǎng)轉(zhuǎn)載的作品目的在于傳遞更多信息,此稿件并不代表本網(wǎng)的觀點(diǎn),本網(wǎng)不承擔(dān)此類稿件侵權(quán)行為的連帶責(zé)任。如果你認(rèn)為此類稿件侵犯了您的合法權(quán)益,請(qǐng)將相關(guān)資質(zhì)證明發(fā)送至mingyou360kf@sina.com,名優(yōu)資源網(wǎng)工作人員會(huì)及時(shí)回復(fù)并處理!